Varför inte låta en intelligent robot bestämma vad du ska rösta på? Då slipper ditt beslut påverkas av sådant mänskligt som irritation över partiledares fula kostymer eller störande dialekter. Det kanske låter skrattretande, men scenariot kan vara närmare än du tror. Därför är det nu vi måste vara på hugget och säkra utvecklingen av en rättvis artificiell intelligens (AI) genom att förebygga monopol och kräva ökad transparens.

AI har de senaste åren gått från att vara stoff i sci-fi-filmer till att användas i allt ifrån jordbruk till fiender i dataspel. Det som skiljer AI-maskiner från andra är att de är självlärande. I dataspelen lär de sig till exempel av sina möten med spelare och utvecklar ständigt sitt beteende.

Stödjer beslutsfattande

Artificiell intelligens används mer och mer som ett stöd i avancerat beslutsfattande och sammanhang som påverkar oss. Till exempel används det i rättssalen, där det hjälper domare i USA att bedöma risker och allvarsgrad i rättsfall. Inom sjukvården har man börjat använda AI för att kunna diagnosticera hudcancer snabbare.

Det finns en poäng med att ta hjälp av maskiner i sammanhang där mänskliga faktorer leder till orättvisa. Vi vet redan att domare dömer snällare precis efter lunchrasten när de är på bra humör, för att inte nämna de fördomar och den rasism som ofta påverkar besluten. När arbetsuppgifter är repetitiva, som att leta tecken på hudcancer på plåtar hos sjukhusen, kan en outtröttlig robot också vara till stor hjälp.

Problemet är att AI precis som oss dödliga präglas av sin uppfostran. I början av en AI-maskins inlärningsprocess är den fullkomligt mottaglig för vilka dumheter som helst. Forskaren Anna Felländer uppmärksammade nyligen i SvD att AI som går igenom historiskt material för att hjälpa företag i rekryteringsprocesser kommer att präglas av patriarkala mönster i tidigare rekryteringar. En dator som lär sig att män brukar tas in som verkställande direktörer kommer fortsätta rekommendera män.

Algoritmen har makten

Beroende på hur en maskin lärs upp skulle den alltså kunna komma med helt olika rekommendationer vad gäller borgen i ett rättsfall. När AI tas in i tunga sammanhang betyder det att den som skriver algoritmen har makten. Detta väcker allvarliga frågor om etik inom AI-utvecklingen, och det finns två saker vi kan göra redan nu.

För det första måste vi parera för monopol. Det finns en stor risk att de bästa utvecklarna inom AI nu samlas i kluster hos de riktigt stora företagen som har råd att finansiera dem. När så stora företag i princip bildar monopol inom AI-utveckling, och alltså inom uppfostran av de maskiner som används i rättssystemet, uppstår problem. Som konstaterat är det den som skriver algoritmen som har makten.

Stora resurser till utveckling i kombination med otrolig tillgång till vår personliga data ger gigantiska företag som Facebook och Google fördelar vi inte vill att de ska ha. Motverkandet av utvecklingsmonopol inom artificiell intelligens är en angelägen fråga om maktfördelning mellan företag och medborgare.

Mer öppenhet ett krav

För det andra måste vi kräva mer transparens av utvecklarna. I nuläget är koden för AI ofta inte tillgänglig alls. I praktiken innebär det att vi inte vet exakt vad AI-maskinerna inom juridiken använder för indikationer för till exempel etnicitet och hur mycket vikt de lägger vid dem, och att en robot därför kan bli lika orättvis som en hungrig domare om den programmeras fel. Koden måste bli mer transparent.

Dagen då AI används som ett komplement även i politiken är inte långt bort. Om vi lärt oss något av transportstyrelsens IT-läcka är det kanske att politiker inte alltid är helintresserade av tekniska detaljer och att det kan få förödande konsekvenser. En stark reaktion nu är bättre än att vakna en morgon av att Mark Zuckerbergs AI-armé knackar på dörren. Se detta som en förvarning och en uppmaning – skärp till utvecklingen av artificiell intelligens innan den hunnit bli ett problem.

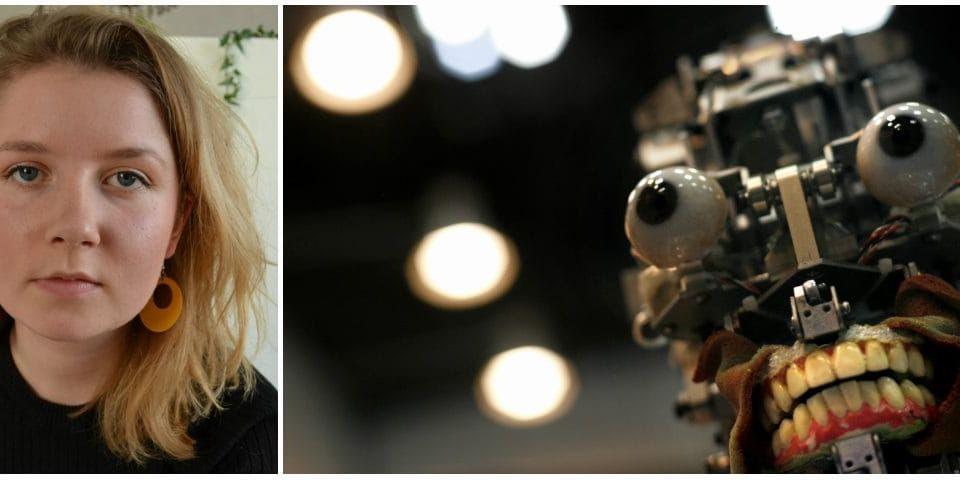

Susanna Kierkegaard

politisk sakkunnig för Socialdemokraterna i Europaparlamentet